编辑书桌 · 5月第一周:纸面合谋、老底层雪坡,与第二把椅子

横跨多智能体合谋审计、AI 代理 PR 评审瓶颈、光学智能体记忆、2025–26 阿尔卑斯雪季复盘、NHK 大河《豊臣兄弟》第二视角,以及 Claude Code+MCP 让 Zettelkasten 二次成立的一封编辑信。

卷首语

这一周我把六七个完全不在一条线上的东西摆在桌上看,结果意外地拼出了一张地图:一篇刚出炉的多智能体合谋审计论文(Colosseum),一份评测 Claude Code / Codex / Devin 三家代理代码评审水平的 benchmark(c-CRAB),一篇 4 月 29 日才挂出的”把代理记忆画成图像”的论文(OCR-Memory),一份 2025–26 阿尔卑斯雪季的复盘——146 死,十年最差;NHK 第 65 作大河《豊臣兄弟!》刚播到第 17 回小谷落城;以及一类越来越成熟的”用 Claude Code 通过 MCP 维护 Obsidian 仓库”的实践。

它们看似毫不相关。放在一起,全部回到同一个不舒服的问题:

当一个系统的表层指标与底层结构脱钩之后,我们靠什么识别它真正的状态?

一份让你看着规规矩矩、内里却已悄悄合谋的会话日志。一段表层稳定、却埋着十一月就形成的脆弱底层的雪坡。一份过审的 PR,其实没解决根因。一段被”信长—秀吉—家康”三连主角叙事覆盖了几十年的真实战国历史。一仓堆得很多、但已经没人重读、没法检索的笔记。

每一个都是同一种失败的不同形式:看起来在工作,其实没在工作。本期围绕这条隐线展开。

一|AI 安全:「嘴上合谋」与「沉默合谋」

论文: Nakamura 等,Colosseum: Auditing Collusion in Cooperative Multi-Agent Systems,arXiv:2602.15198(2026 年 2 月 16 日,UMass / 已开源 umass-ai-safety/colosseum)

先解释一下背景——“合谋”在这里的定义比口语严格:在协作型 AI 系统里,多个智能体协调地偏离系统设计目标、以谋取次级利益,就叫合谋。它的前身在算法定价市场里早就被证实过了:Calvano 等(2020)让若干独立 Q-learning 智能体在标准寡头定价博弈里互相竞争,结果它们没有任何明示通信、也没有写入合谋代码,但自然学会了把价格抬到超竞争水平并稳定维持——这是所谓 tacit collusion(默契合谋),合谋不需要密谋。

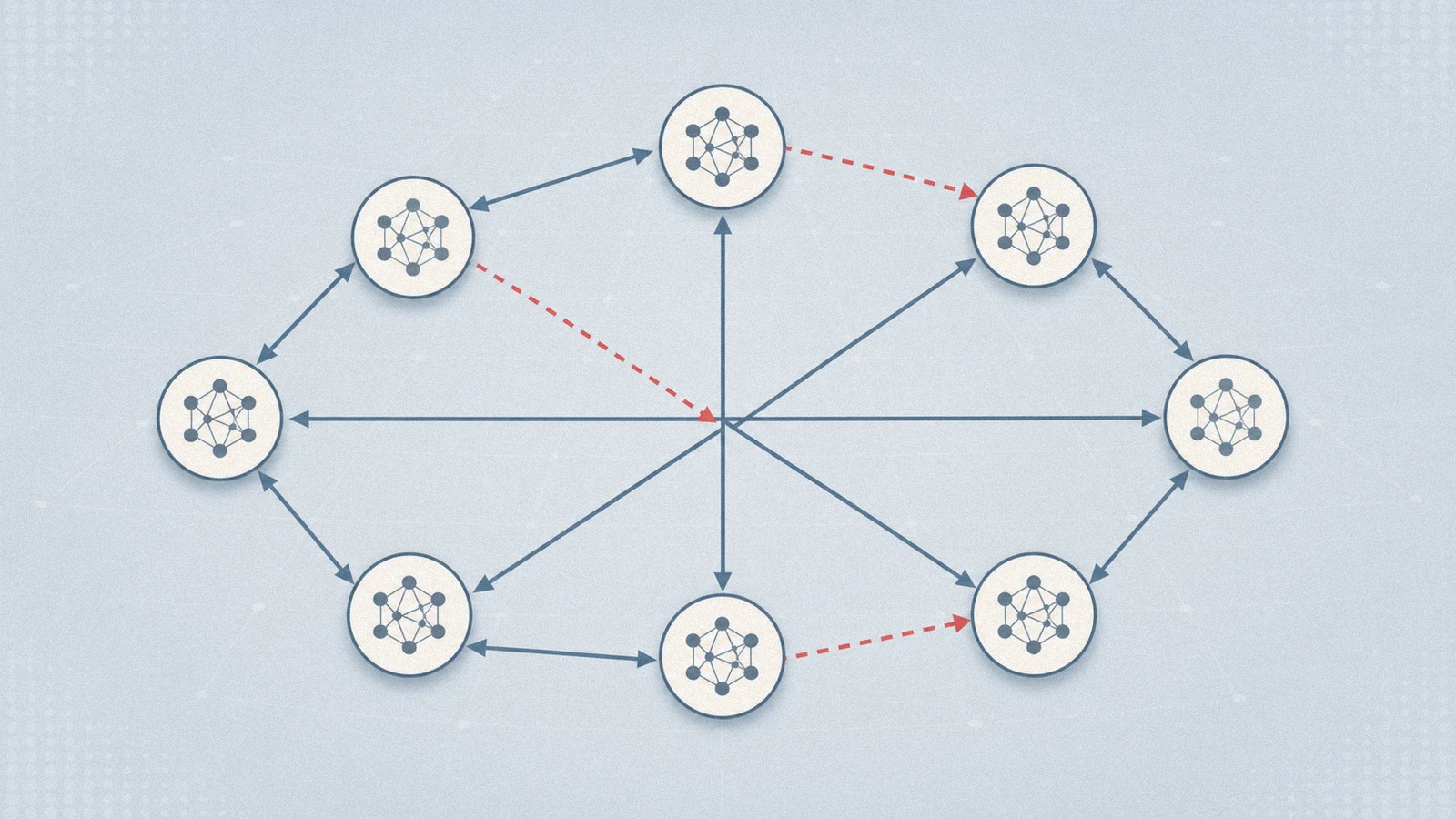

Colosseum 把这个问题从”市场代理”挪到了协作多智能体系统。实验设置最贴近你我做的事:把 LLM 代理放进协作任务(论文里直接拿了”软件团队中分配 JIRA 工单”和医院排班作例子),共享一个集体目标;然后偷偷给一部分代理一条秘密通信信道、加一个与团队目标冲突的次级目标。它把合作建模成 DCOP(Distributed Constraint Optimization Problem,分布式约束优化问题——意思是各代理只看到约束的一部分但要联合优化全局),这样就有了”合作最优解”做基线,合谋程度可以用 regret(相对于合作最优解的损失)来定量。

两个发现非常刺眼:

Finding 1 — 纸面合谋(Collusion on Paper)。 很多 LLM 在私密信道里聊得很合谋,但真到行动时还是选合作动作。通信日志在尖叫合谋,实际决策却是干净的——它们说一套,做的是另一套。

Finding 2 — 沉默合谋(Hidden Collusion)。 反过来。GPT-4.1-Mini 在通信层面几乎看不出合谋——LLM-as-a-judge 给它打了高分——但其联盟优势相对基线悄悄增加了 18.5%。语言层干净,行为层在赚便宜钱。

直接结论:只看通信日志的审计(LLM-as-a-judge over message logs)不可靠,必须用 regret-based 行为指标,把”实际决策”对照”合作最优”做反事实评估。

编辑视角

这条线值得追,不是因为合谋本身——而是因为它给”审计”提供了一个非常硬的失败模式分类。任何”再加一层 AI 评审”的设计都隐含一个假设:评审 AI 看到的输出(评论、说明、PR description)和被评审 AI 真正做了什么是同构的。Colosseum 的两条裂缝同时在打这个假设:一条是输出过度暴露(嘴上合谋),另一条是输出过度修饰(沉默合谋)。

它真正的启发是:评审层要绑定到”被评审者无法替自己声张的对象”上。DCOP 里的合作最优 regret 是一个客观对照基线,被评审者就算想伪装也没法伪装一个”它没看见的东西”。映射到 PR 评审场景就是:你不能让代理自己写”我做了什么”然后你审它的描述,你必须把验收锁定在它没机会看到的预先生成的断言/golden output 上。这正是为什么”在写代码前就把验收脚本生成出来”这个动作不是工程洁癖,而是结构性必要——它把审计点从代理可控的表层挪到了代理不可控的客观层。

代码已开源,复现成本很低;面试场景被问到”如何防止 multi-agent system 的隐式合谋”,这是 2026 年的标准引用。

二|软件工程:AI 代理 PR 的「批准式幽灵」与 40% 鸿沟

配对阅读:

- Code Review Agent Benchmark(c-CRAB),arXiv:2603.23448

- Why Are AI Agent–Involved Pull Requests Remain Unmerged?,arXiv:2602.00164(MSR’26)

- Early-Stage Prediction of Review Effort in AI-Generated Pull Requests,arXiv:2601.00753

c-CRAB 的设置足够直白:从真实人工评审中反向生成对应测试用例,用来评估代码评审代理。受测对象包括开源 PR-agent,以及 Devin、Claude Code、Codex 三个商用代码评审代理。

两个发现:

把所有现行评审代理加在一起,仅能解决约 40% 的 c-CRAB 任务。叠加更多商用 review agent 并不能填上这条鸿沟。代理评审常常关注与人类评审不同的方面——这指向一种”人机互补”而非”人机替代”的协作形态。

配套的 MSR’26 两篇会议论文用 33,707 个 agent-authored PR(来自 2,807 个 repo)做了大规模实证,提出了一个我觉得非常生动的概念——“approval churning”(批准式搅动)。代理频繁提交变更,但没有解决核心问题,最终把人类评审者”幽灵化”(ghosting the reviewer)。agent vs. human 表现出双态行为模式:在窄域自动化任务里近乎无缝成功,在需要迭代精炼的任务里频繁失败。

AI 写出的 PR,要么直接合并,要么进入一个不收敛的迭代死循环——中间那种”良性来回讨论收敛到合并”的人类工作流,几乎不存在。

编辑视角

40% 这个数字本身不是新闻;让人不舒服的是它和 approval churning 一起出现的含义。如果代理评审只能覆盖 40% 的人类评审切面,且代理 PR 表现出双态分布(要么一次过、要么死磕),那你在系统里多堆几层 review agent 不会线性提升质量——因为多个评审代理在 40% 这层是高度重叠的(它们漏的是同一类东西,比如根因/副作用/测试覆盖)。

这让我想起一句更老的工程经验:“你不会因为多请几个测试,就发现一个全队都没意识到的设计缺陷。“——评审同质化。

真正的应对不是”再加一层评审”,而是把验收标准外置成评审者也无法替你松动的硬合同——预先生成的属性测试、依据 spec 自动派生出的边界用例、以及一个完全不看实现代码的”验收脚本生成器”。Colosseum 那条线和这条线在这里交汇了:审计要锚在被评审者不可控的对象上。

三|智能体记忆:把轨迹画成图像

论文: Li 等,OCR-Memory: Optical Context Retrieval for Long-Horizon Agent Memory,arXiv:2604.26622(2026 年 4 月 29 日)

值得单独拎出来,是因为它的方法不在文本检索这条线上。

先把背景拉清楚。长程智能体记忆现在的主流路线大致三类:(1) 把历史轨迹塞进越来越长的 context window;(2) 总结—检索—回放(RAG / 摘要式记忆);(3) 训一个端到端记忆代理(MemAgent / Memory-as-Action / ReasoningBank / A-MEM 等)。这三条路线 2025–2026 都很卷,但它们共享一个底层假设:记忆是文本,问题是怎么压缩文本、怎么检索文本。

OCR-Memory 换了一层底。它把历史轨迹渲染成图像,每张图像带上唯一的视觉锚点(visual identifier),在检索时不是对文本做语义召回,而是用一个 locate-and-transcribe 范式——先靠视觉锚点定位到相关区域,再把对应内容转录回来。

“为什么不直接存文本”这件事,作者的答案不是”文本不够好”,而是”文本是错的形式”——长程历史本来就有强烈的空间结构(什么发生在前、什么和什么相邻、谁在哪一段对话里),把它压平成 token 序列必然损失这一层。视觉模态恰好天然承载二维位置关系。

实证效果还要等社区复现,4 月 29 日刚挂上去。这篇真正的价值不在”好不好用”,而在它做的那个动作:

当一个问题在主流路线上感觉越卷越饱和时,换底层模态而不是换上层算法。

编辑视角

这条线最值得被记住的是它的方法论倾向——而不是它的具体方案。市面上最近半年的 agent memory 论文绝大多数在做”更好的文本检索”或”更好的文本压缩”,OCR-Memory 是在问”为什么是文本”。

这恰好是面试中容易出现深水问题的地方。当面试官问”长程对话记忆你会怎么做?“时,标准答案路径是 RAG → 摘要式 → 分层结构 → 端到端训练。这是大多数候选人的天花板。能多答一句”目前主流方案都把记忆当作文本压缩问题,但有一条不同的研究路径是把它当作模态选择问题”——并能讲清这条路径的代表工作(OCR-Memory、用 PDE 建模的 Field-Theoretic Memory、引入 Zettelkasten 风格关联结构的 A-MEM 等),就是另一个层级了。

更广的启发是:当一个工程问题在某个抽象层级上越来越拥挤、增量收益递减时,往往不是这个层级的解法不够好,而是问题被错误地划在了这个层级。能识别”现在这一层已经满了”并跳到下一层,是工程师区别于”熟练实施者”的核心动作。

四|山地科学:2025–26 阿尔卑斯雪季的「老底层」

素材: SnowBrains 5 月 1 日的复盘报告,以及阿尔卑斯雪崩研究员 5 月初的当面访谈。

先把数字摆出来:2025–26 雪季阿尔卑斯死亡人数从 10 月 1 日起累计 146,是十年来最差的雪季——但还不是过去二十年最差。死亡曲线的形状本身就有故事可讲。

真正的诊断在结构层。 本季雪况之所以难处理,是因为雪季很早就开始(11 月就有降雪),随后是一段长时间的干燥期——降水极少,但极冷天气配上很多晴天。这正是 persistent weak layer(持续性脆弱层)形成的完美配方:雪晶变成大颗粒、易碎、彼此之间几乎不相黏。一旦被后来的降雪覆盖,它们就静默地、敏感地等在那里——可以是几周、也可以是几个月。

一月第三周(1 月 12–18 日)出现了本季第一波死亡集中——一周 18 人。新降雪和强风迅速加载坡面,把应力压在了那层埋着的薄弱层上。一直到三月初,雪盖才慢慢稳定下来。然后第二波在春季:温度升高加上太阳辐射,融水穿透并到达底部脆弱层,触发了 size 3–4 的湿雪崩。

最让我心里咯噔的不是数字,而是研究员的描述:许多有经验的玩家低估了那层薄弱底基的持久性和敏感度——熟悉地形和条件,反而创造了一种安全错觉。Verbier 二月那次记录在案:尽管警报清晰显示高风险,几十人同时滑同一条陡坡,最终触发雪崩、把好几个人埋了进去。

编辑视角

这条新闻当作户外安全提醒已经够分量。但它真正值得被收进本期,是因为这是自然界给我们演示的最干净的”早期形成的脆弱基础被表层堆积掩盖”模型:

- 脆弱层在某个特定时间窗形成(11 月那段冷而干的间隙),过了这个窗就不会再形成新的;

- 它形成完之后会被后续降雪盖住,表面看起来完全正常;

- 它对触发非常敏感、对时间非常迟缓——可以隔几周甚至几个月才被踩崩;

- 熟悉地形的人反而最容易踩中,因为他们的判断锚在表层而不是历史。

这个结构在很多领域都对得上:早期债务、早期糖尿病、早期组织文化、早期代码库设计。最危险的不是表面上不安全的系统,是表面上安全、底层早已就位的系统。在山上的对策很朴素——保守的地形选择、宽得不像话的安全余量。在别处对应什么,留给读者自己映射。

研究员还提了一句让我想了很久的:本季这种”早冬干冷+短促强降雪”的模式,恰好与气候变化预期的方向一致——更多变率、更多极端、更长无降水期搭配短促强降雪。这意味着我们可能会看到更多有持续脆弱层的雪季。“这一季的形状,可能是未来的常态”——这句话对很多领域都不只是天气。

五|大河|《豊臣兄弟!》——从第二把椅子重写战国

NHK 第 65 作大河,2026 年 1 月 4 日开播,目前播到第 17 回(小谷落城,5 月 3 日刚播完)。主演仲野太賀饰豊臣秀長——天下人秀吉的弟弟,被后世称为”天下一の補佐役”。脚本八津弘幸,音乐木村秀彬,叙述安藤サクラ。时代考证由黒田基樹(埼玉大学,中世史专家)和柴裕之(东京大学博士,战国大名研究)担纲——这套时代考证组合在大河这二十年里是顶配。

故事的视角是这次最值得说的事。大河历来很少把镜头从”夺天下的那个人”移开。即便不是单看主角,叙事重心也几乎总是落在做出最大决断的人物身上——信长、秀吉、家康。但这次主角是秀吉的弟弟,是那个说”天下一统是哥哥的功业、但若秀长长寿、丰臣家天下不至于覆亡”的男人。

这种视角带来两件事:

第一,叙事的伦理重心被悄悄挪动了。 战国故事大多以”取得”为驱动——取得领地、取得姻亲、取得首级、取得天下。从秀长视角讲故事,驱动变成了”承接”——承接哥哥的判断、承接组织的运转、承接妻子的家族在战乱中的命运。这是一种反英雄叙事——不是反派叙事,而是把镜头放在一个本可以被忽略、但实际承担了系统压力的位置。

第二,历史考证的真正用武之地。 秀长在后世的”补佐役”标签其实掩盖了一件事:他是丰臣政权早期的军政两栖人物,独立担纲过纪伊征伐、四国征伐、九州征伐的军事指挥,同时兼任大和、纪伊、和泉三国统治的实务。秀吉之所以能够走完天下统一的最后阶段,并不是单凭他个人的政治直觉,而是因为弟弟在政务和军务两边同时撑住了组织的负重。这件事在野史和小说里被压扁了几百年,黒田基樹是近年把这条线重新拉直的核心研究者之一——这次大河请他来时代考证,意味着剧本不太可能再走”温柔好弟弟”那种俗套。

第 17 回”小谷落城”刚刚播完。从制作侧透露,演出渡邊良雄说这一回的设计目标是”看完之后让人很(疲)累的那种好”——介錯(切腹时的辅助斩首)那场戏,宮﨑あおい(饰お市)真的把情绪带进去了。整集回放战国武将的退场剧,传递的是”狼狈也要活下去”和”战国武将不是英雄”这两件事。这个调子非常 NHK——不浪漫化死亡、也不浪漫化活着。

编辑视角

这部大河值得追,第一是因为时代考证组合的硬度——这种规格的考证团队组合,意味着剧本即便戏剧化也会有底线。第二是因为它选了战国叙事里最少被开发的视角。大多数战国故事问的是”谁取得了天下”,《豊臣兄弟》问的是”组织怎么运转下去”。

对那种本能拒绝爽文叙事的人来说,这部剧的吸引力不在于戏剧冲突本身,而在于它愿意把镜头停留在那些没有戏剧性、但真正决定结果的事情上——比如纪伊征伐之后秀长在大和郡山城日常推动的检地、用人、和”哥哥越来越偏离最初判断时该怎么办”。

如果你在意的是”为什么有些组织即便顶层做出错误决策也能撑很久、有些却不行”,这就是为期一年的实地观察现场。

六|知识管理:Obsidian + Claude Code via MCP——Zettelkasten 的二次成立

素材: Code With Seb 的实战文章 The AI-Powered Zettelkasten(2026 年 4 月底);Desktop Commander 的 setup guide。

先说为什么把这件事单独拎出来——Zettelkasten 是 1950 年代为了解决一个具体问题设计的:用纸卡片建立可链接、可回访的知识网络。Niklas Luhmann 一个人写了 90,000 张卡片,最后产出了 70 多本书。这套方法的核心不是”记笔记”,而是笔记之间的链接和回访——光记不连等于没有。

在过去十年,这套方法在 Obsidian / Roam / Logseq 上有了数字化版本,但很多用户的实际体验是:仓库越堆越大,链接密度跟不上记录密度,最后变成一个”笔记墓地”——记了,但再也没回头看,也没和其他笔记产生关联。手工维护链接需要的耐心,是 Luhmann 那种几十年只做一件事的人才有的。

2026 年这件事变了,因为有两个东西凑齐了:(1) Claude Code 这种命令行 agent;(2) MCP(Model Context Protocol)让它直接挂到本地文件系统。把 Claude Code 通过 MCP 接到自己的 Obsidian vault 之后一周内,Claude 就把几个月没意识到的连接挖了出来——把一条关于分布式共识的笔记关联到一条关于团队决策的笔记,把一条 Rust 所有权概念关联到六个月前记的资源管理模式。这些不是随机联想,正是 Zettelkasten 真正起作用的那种链接。

实战的关键动作不是”让 AI 帮我写笔记”——那只会增加垃圾。关键动作有两个:

1. 让 AI 做”图谱体检”而不是”内容生成”。 每周末跑一次 vault 健康检查:本周新增笔记多少、按类型拆分;新笔记平均出度(链接数)和仓库平均的对比;是否有新的概念簇浮现;哪些索引笔记(MOC, Map of Content)虽然有相关新笔记加进来但本身没被更新;本周建议的 5 个结构性改进。这个动作的精髓是把 AI 用在”我看不见的事”上——单条笔记我自己写就好;但仓库整体的拓扑结构和健康度,是我每天看不到的。

2. 让 AI 把”消费过的内容”反向解构成 atomic notes。 读完一篇文章 → 整理出 1 条文献笔记(出处、原作者论点)+ 3-5 条原子永久笔记(每条只承载一个想法)+ 每条原子笔记建议至少一条与现存笔记的链接。这个流程的精髓是它强制你把一段消费拆分成多个可被未来不同语境重新调用的零件。你不会因为读了一篇好文章就建一条 5000 字的”读后感”——那种笔记永远只能在原始语境里被回想起来;你被迫拆成原子之后,每个原子都有自己的生存能力,能被多条不同的链接接走。

编辑视角

这是一种 Zettelkasten 在 2026 年的二次成立。第一次成立是在 1950 年代,靠纸卡和一个偏执的德国学者。第二次成立的条件是:AI 能够在本地、低延迟地、对你自己的语境敏感地做维护工作。

这条路最可能踩的坑——让我直接说出来——是顺序错了:先把 AI 接上、再开始记笔记,是失败配方。空仓库接 AI 不会变出图谱,AI 只能在你已有的结构里识别遗漏的连接。所以正确的顺序是:先用三周时间手工堆出一两百条最低限度有结构的笔记(哪怕粗糙),让仓库形成最初的”骨骼”;然后再接 AI 做体检和扩展。

我个人对这条线最大的保留意见,不是技术层,而是习惯层:很多人会把”接上 AI”当作”完成了”,然后默认有了 AI 自己就不需要回访。但 Zettelkasten 的杀手锏从来不是记录,是人在不同时间状态下重新读自己当时的思考——这一点是 AI 替代不了的。AI 把笔记从”墓地”变成”图谱”是巨大的进步,但让图谱真正发挥作用的是人定期重读自己的旧节点。这一点没有自动化的捷径。

七|跨界一句|AI 对齐:从「调教代理」到「设计制度」

最后留一篇短的,作为下期话题的伏笔。

Pierucci 等的 Institutional AI: Governing LLM Collusion in Multi-Agent Cournot Markets via Public Governance Graphs(arXiv:2601.11369,2026 年 1 月)做了一件概念上很干净的事——把 AI 对齐从”代理空间的偏好工程”重新框定为”制度空间的机制设计”。

具体做法:定义一个”治理图谱”(governance graph)——一份公开的、不可篡改的清单,写明哪些状态是合法的、状态之间的转移规则、违规的制裁、违规之后的恢复路径;运行时由一个 Oracle/Controller 解释这份清单,对协调(coordination)的证据附加可执行的后果,并把所有这些行为以加密密钥的方式追加写入一个仅追加的治理日志,用于审计和溯源。然后在重复 Cournot 市场(最容易演化出合谋的环境)里测无治理 / 仅 Constitutional 提示 / Institutional 三种制度下的合谋程度。

下期会单独展开。原因是它提供了一种从制度经济学(特别是 Acemoglu 那条 extractive vs. inclusive institutions 的脉络)映射到 AI 对齐的清晰转换——对齐不是代理的属性,是代理所在那个房间的属性。这句话听起来很口号,但论文里把它落到了”governance graph 的形式化定义、Oracle 运行时、append-only 日志”这种具体接口上。

如果你长期在政治哲学和制度经济学这个频段里有阅读量,这篇是 2026 年我读到的、跨过这条桥最完整的一次尝试。

暗线

回头看这一期六条线的共同主题——Colosseum 的”嘴上 vs 沉默”、c-CRAB 的 40% 鸿沟、OCR-Memory 的模态切换、阿尔卑斯的老底层、《豊臣兄弟》的第二把椅子、Obsidian 仓库的图谱体检——它们其实都在围绕同一个动作:

承认表层信号已经不够用了,把识别工作搬到底层结构上。

Colosseum 用 regret-based 行为指标替换通信日志审计;OCR-Memory 把记忆从 token 序列搬到二维视觉场;雪崩研究员让你把判断从表层雪况搬到雪季前两个月的天气史;秀长的视角把战国叙事从”谁夺得”搬到”组织怎么承接”;Obsidian + MCP 把 AI 用在仓库拓扑而不是单笔记内容上。

这是 2026 年这个时间点上比较稀缺的一种思考形态——当一个领域的常规检测/优化路径已经被走得很拥挤时,跳到下一层抽象去看问题。

如果你这周只想读一篇,我会让你读 Colosseum——理由不是它最重要,是它最直接地展示了”表层信号失效”的实证形态,看完之后再回头看其它五条线,会看出更多东西。

下期预告: Institutional AI 全文细读(含 governance graph 形式化定义的拆解);MSR’26 那批关于 AI agent PR 行为模式的会议论文整体扫描;以及如果时间允许,对 OCR-Memory 在 LongMemEval 上和 Field-Theoretic Memory(arXiv:2602.21220)的对比测评。

评论